企業の業務効率化や創造力強化など、多彩なシーンで活用されている生成AI。最新技術として注目される一方、情報漏洩や誤情報の拡散といったリスクも伴います。そこで多くの企業が導入しているのが「生成AIガイドライン」です。

この記事では、実際の企業で導入している生成AIガイドラインの策定事例を10選ご紹介します。デジタル省や文部科学省・東京都の事例もお伝えするので、生成AIガイドラインを通じてAI活用の最前線を知りたい方は、ぜひ参考にしてください。

生成AIガイドラインとは?

生成AIガイドラインとは、生成AIの技術を安全かつ効果的に使うための基準・ルールをまとめた指南書です。主に、生成AIのメリットを最大限に引き出すこと、同時にリスクを最小限に抑えることを目的としています。

生成AIが企業で活用されるようになった背景

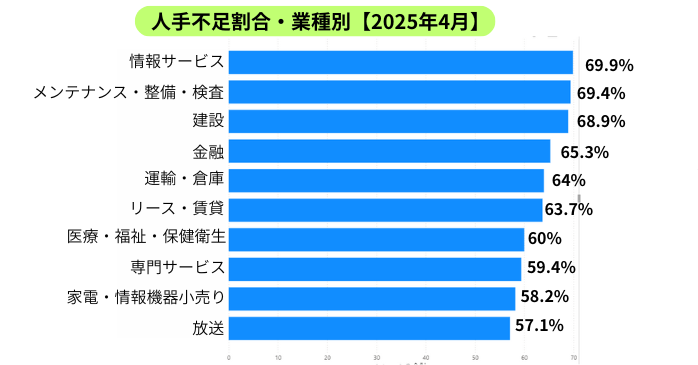

生成AIを業務活用する企業が増えているのは、人手不足という課題解決に有効な手段として着目されているためです。上記画像のように、2025年4月に帝国データバンクが実施した調査でも、広範な業界で人手不足感が深刻化している現状は明らかです。

特に、「情報サービス」業では69.9%と約7割の企業が人手不足を感じており、これに続き、「メンテナンス・整備・検査」が69.4%、「建設」が68.9%と、いずれも約7割に迫る高水準でした。加えて、上位10業界全てで5割を超える企業が人手不足を実感していることからも、人材確保の困難さが浮き彫りになっています。

参照:帝国データバンク

生成AIガイドラインが必要な理由

生成AIは、画像や文章の自動生成を通じて、人手不足解消や業務効率化に大きく貢献し、さらに、今までにはなかった新たな価値をもたらす画期的技術です。しかし、その活用には以下のような複数のリスクが伴います。

- 著作権侵害

- 誤情報生成

- 倫理的問題

- 機密情報漏洩

これらのリスクを回避しつつ、生成AIの恩恵を最大限に享受するために、多くの企業・自治体は生成AIガイドラインを独自に策定しています。

生成AIガイドラインに盛り込む主な要素

以下は、多くの企業が生成AIガイドライン策定時に重視している代表的な要素です。

| 項目 | 内容 |

| リスク管理 | フェイクコンテンツ、著作権侵害、ハルシネーションなどのリスクの管理 |

| 倫理的配慮 | 差別や偏見を避け、プライバシーや透明性に配慮した利用を促進 |

| 責任の明確化 | 生成AI利用時の責任の所在を明確にし、問題発生時の対応体制を整備 |

| 法的コンプライアンス | 関連法規に準拠し、違反リスクを未然に防止 |

| 社会的信頼の確保 | 社会全体からの信頼を得ることで、技術の健全な発展を促進 |

| 機密情報の管理 | 企業の機密事項や個人情報入力の禁止、例外的入力時の承認者の明確化 |

| 使用する生成AIツール | ChatGPTやGeminiなど、定めたツールのみの利用を明記 |

著作権侵害対策は必須

生成AIガイドライン策定時に、必ず含めておきたいのが画像生成AI時における著作権侵害です。画像生成AIは意図せず著作権を侵害するコンテンツを生成するケースがあり、これを知らずに商用利用した場合、著作者の権利を侵害することになります。

また、生成AIツールによっては商用利用自体を禁止しているため、この場合は規約違反となり、アカウント停止、企業の信用失墜など、様々なリスクを伴います。

このように生成AIを適切に使うためには多くの知識が必要です。

もし、生成AIを使いたい、もしくはすでに活用している方は、ぜひこの機会に生成AIセミナーに参加して、生成AIのリスク、そして業務効率を劇的に変えるプロンプト入力術を習得しましょう。

生成AIの著作権侵害については、以下の記事をご参照ください。実際に著作権侵害した海外の事例についてもお伝えしています。

AIでできること、メリットやデメリットについては以下の記事でご確認ください。AIの歴史から身近な事例、AI関連で使われる専門用語まで多角的に解説しています。

生成AIガイドライン策定の基本の4ステップ

生成AIガイドラインは、現場で本当に機能する実効性が必要です。

生成AI活用を円滑に進めるためにも、そして「結局活用できなかった」という状況を避けるためにも、これから紹介する4ステップで生成AIガイドラインの策定を進めましょう。

- 他社の事例を調べる

- 自社の利用実態を把握する

- リスクへの対策を検討する

- 専門家に内容を確認してもらう

① 他社の事例を調べる

まずは、すでにガイドラインを公開している企業や団体の事例を調査しましょう。複数の内容を比較することで、共通して重視されているポイントや業界ごとの注意点が見えてきます。これにより、自社にとって必要なルールを効率よく整理できます。

② 自社の利用実態を把握する

次に、自社内で生成AIがどのように使われているのかを分析します。例えば、マーケティング部門でのコンテンツ作成や、開発部門でのコード生成など、実際の活用シーンを想定し、業務への影響やリスクを明らかにすることが重要です。

③ リスクへの対策を検討する

続いて、法律や社内ポリシーに照らしながら、どんなリスクに備えるべきかを考えましょう。例えば、著作権や個人情報の取り扱い、生成物の公開方法や利用範囲の制限など、具体的なルールを決めておくことでトラブルを未然に防げます。

④ 専門家に内容を確認してもらう

最後に、策定した生成AIガイドラインのチェックを専門家に依頼しましょう。外部から助言を受けることで、見落としていたリスクにも気づくことができ、ガイドラインの完成度が一段と高まります。

生成AIガイドライン策定事例12選!

ここでは、生成AIガイドラインの策定事例を12選ピックアップし、企業・団体と自治体・官公庁の2ジャンルに分けてご紹介します。まずは、それぞれの生成AIガイドラインの概要をまとめた一覧表をご確認ください。

| 企業・団体名 | 生成AIガイドラインの概要/特徴 |

| 富士通 | 5大リスク対策と具体的な対応策を提示 |

| Adobe | サービス利用者向けに安全な利用と禁止事項を明示 |

| 三菱UFJフィナンシャル・グループ | 金融機関の責任あるAI活用に向け9つの原則を策定 |

| LINEヤフー株式会社 | AI倫理基本方針 8項目で倫理と安全性を重視 |

| 一般社団法人日本ヘルスケアデータ協会 | ヘルスケア特化の安全なAI活用と規制対応を指針 |

| 一般社団法人日本ディープラーニング協会 | 独自の生成AIガイドラインを一般企業にも公開 |

| デジタル庁 | 政府AIの安心・安全な調達・利活用を推進 |

| 文部科学省 | あくまで人間中心で情報活用能力を育成 |

| 東京都 | 都職員向けに活用ルールと実践例を明示 |

| 愛知県 | 行政業務の安心・安全なAI活用とリスク管理 |

| 岐阜市 | 職員の生産性向上、安全な業務支援AI活用の指針 |

| 福岡県 | 特定AIサービス(QT-GenAI)に限定した行政活用ルール |

①企業・団体の生成AIガイドライン策定事例

生成AIガイドラインの導入は、大手企業をはじめ近年急速に加速化しています。ここでは、6つの企業・団体の生成AIガイドラインを見てみましょう。

富士通

富士通の生成AIガイドラインは、生成AIの能力を評価しつつ、その活用によって生じる潜在的なリスクへの対策に焦点を当てています。特に注意すべき以下の5つの主要なリスクを特定し、それぞれに対する具体的な対策を提示しています。

| 項目 | 主な内容 |

| 正確性 | 誤情報の可能性にダブルチェックで対応 |

| 公平性 | 学習データ由来の偏りを意識し、公平な利用を推奨 |

| 著作権侵害 | 既存著作物との類似性回避や利用規約の確認を徹底 |

| 情報管理 | 秘密情報や個人情報の漏洩を防ぐため、入力制限を推奨 |

| 悪用 | フェイクニュースや詐欺への利用に対するリテラシー向上 |

参照:富士通

Adobe

Adobeの生成AIガイドラインは、同社サービスを利用するお客様向けに、生成AI機能の安全な使用を促すものです。Adobeは、違反行為に対しアカウント措置を講じる場合があるとしており、利用者に責任あるAI活用を求めています。

| 項目 | 主な内容 |

| AIトレーニング禁止 | 生成AI機能をAIモデルの訓練には使用できない |

| 品位と安全の確保 | 違法・不適切コンテンツの生成、共有を禁止 |

| なりすまし禁止 | 虚偽の情報や自動化された不正利用 |

| 第三者の権利尊重 | 著作権、商標、プライバシーなどを侵害するコンテンツ作成 |

| 判断力の重要性 | AI出力の正確性を確認し、専門的助言としては利用しない |

| 商用利用 | 通常は可能だが、ベータ版など一部は個人利用に限定 |

引用元:Adobe

株式会社三菱UFJフィナンシャル・グループ

三菱UFJフィナンシャル・グループは、生成AIガイドラインに相当する「MUFG AIポリシー」を策定しました。ポリシーに挙げた9つの原則を通じて、AIの安心・安全な活用を促し、金融機関として信頼される生成AI活用を進めています。以下は、主要な4項目です。

| 項目 | 主な内容 |

| 信頼性・安全性 | AIの適切な動作確保と危害防止 |

| 公平性 | 不当な偏見・差別の排除 |

| 知的財産・プライバシー | 関係法令遵守による保護 |

| AIリテラシー | 従業員の知識・倫理観向上 |

引用元:「MUFG AIポリシー」

LINEヤフー株式会社

LINEヤフーは、AI活用における倫理と安全性を重視し、「AI倫理に関する有識者会議」を2021年に設置しました。外部専門家との議論を重ね、2022年7月には生成AIガイドラインに相当する「AI倫理基本方針」を策定しました。この基本方針は、以下を含めた8項目で構成されています。

- 透明性と説明可能性の追求

- 安全性とセキュリティの確保

- プライバシーの保護

- AI人材の育成

引用元:LINEヤフー株式会社

一般社団法人日本ヘルスケアデータ協会

一般社団法人日本ヘルスケアデータ協会(JaDHA)は、ヘルスケア分野での生成AI活用を安心・安全に進めるため、以下の内容を含んだ生成AIガイドラインを策定しました。

| 項目 | 主な内容 |

| 基盤モデル選定 | 用途や商用利用可否を考慮し、最適なAIモデルを選択 |

| データ取扱 | 個人情報や著作権に配慮し、データの適正な管理・利用を徹底 |

| 出力信頼性・説明 | AIの出力は誤りを含む場合があるので、必ず確認して利用者には説明 |

| 規制対応 | 医療機器プログラム該当性など、ヘルスケア特有の法規制への適合を確認 |

参照:日本総研

一般社団法人日本ディープラーニング協会

一般社団法人日本ディープラーニング協会(JDLA)の生成AIガイドラインは、同社の従業員が生成AIを安全かつ効果的に使うための注意点をまとめたものです。このガイドラインは、企業のAI活用をサポートすることを目的とし、公式サイトで誰でもダウンロードできます。

| 項目 | 主な内容 |

| データ入力 | 機密情報・個人情報・秘密情報・他者の著作物などの入力は慎重に |

| 生成物利用 | AI出力は事実確認必須。著作権や名誉毀損リスクに注意し、AI生成物の明示も検討 |

| 倫理的配慮 | 公平性・透明性・説明責任を意識。差別や不適切な利用は避ける |

| 組織・教育 | AIガバナンス体制構築と、従業員のAIリテラシー向上を推進 |

②自治体・官公庁の生成AIガイドライン策定事例

東京都やデジタル庁など、多くの公的機関でも生成AIガイドラインを策定しています。

デジタル庁

デジタル庁の生成AIガイドラインは、「人間中心のAI社会原則」に基づき、生成AIの調達・利活用における安心・安全な推進を目指したものです。行政効率化や政策・サービスの質向上、国際競争力強化など、9つの利益実現を目標としています。

このガイドラインは、大規模言語モデル(LLM)を構成要素とするテキスト生成AIを対象とし、生成AIの調達・利活用に関わる政府職員に適用されます。ただし、特定秘密や機微な情報を扱うシステムは対象外です。

参照:行政の進化と革新のための生成AIの調達・利活用に係るガイドライン

文部科学省

文部科学省の生成AIガイドラインは、学校現場での生成AI活用を「人間中心のAI社会原則」に基づき推進するためのものです。ガイドラインでは、生成AIを人間の能力を拡張する有用な道具と捉え、最終的な判断と責任は人間が持つべきと示しています。

- 適切な課題設定と真偽判断力の育成

- 実体験とICT活用のバランスに配慮

- AIリテラシーの習得と研修機会の提供を推進

- 生成AI普及に伴う情報活用能力の育成強化

東京都

東京都は、「文章生成AI利活用ガイドライン」(東京都デジタルサービス局)で、都職員に対するChatGPTなどの活用ルールと実践例をまとめた生成AIガイドラインを策定しています。概要を以下に整理しました。

- 安全な運用と業務効率化の両立

- プライバシー・著作権・出力検証・AI明記

- Azure環境で入力・保存を制限

- 34事例&プロンプト集で具体的指針

- アンケートから改善、継続的アップデート

愛知県

愛知県は、行政業務で生成AIを安心・安全に活用するための生成AIガイドラインを策定しました。このガイドラインでは、以下のような内容が書かれています。

| 項目 | 主な内容 |

| 推奨される活用方法 | アイデア出し、文章翻訳、プログラムコード作成補助など |

| 適切なデータ入力のルール | 個人情報や機密性の高い情報のAIへの入力は禁止 |

| 生成物の確認と責任 | AIの出力は誤りや偏見を含む可能性があるため必ず内容を確認 |

| 著作権・利用規約への配慮 | 生成物が他者の著作権を侵害しない、利用規約に反しない |

| 過度な依存の回避 | 職員自身の思考力や判断力が低下しないよう、過度な依存を避ける |

岐阜市

岐阜市は、生成AIの利便性とリスクを考慮し、「岐阜市生成AI利活用ガイドライン」を策定しました。このガイドラインでは、職員の生産性向上を目指し、主に以下の点が定められています。

| 項目 | 主な内容 |

| セキュアな利用環境の確保 | LGWAN環境での利用など、安全な環境での利用を前提 |

| 厳格な入力ルール | 個人情報や機密性の高い情報の入力は禁止 |

| 生成物の厳重な確認 | AIの出力に虚偽や古いものが含まれていないかを確認 |

| 最終判断と責任は人間 | 業務における最終的な判断と責任は利用する職員にある |

| 効果的な活用分野の明示 | AIが特に力を発揮する分野の記載(文章作成、アイデア出し) |

福岡県

福岡県は、行政事務に活用する生成AIサービスとして、株式会社QTnet提供のチャット型テキスト生成AIサービス「QT-GenAI」を選定し、利用ガイドラインを策定しました。

原則として、福岡県の行政事務ではQT-GenAIのみが使用可能であり、これまでのMicrosoft Copilot(旧BingChat)を含む他の生成AIサービスの利用は控えるよう定めています。

このガイドラインは、知事部局を含む県の各機関の職員と業務に適用され、社会情勢の変化に応じて随時更新されます。

参照:福岡県

生成AI活用をサポートする生成AIガイドライン

生成AIは、いまや誰にとっても身近な存在になりつつあります。文章作成、アイデア出し、資料の整理など、ちょっとした工夫で日々の仕事や生活が驚くほどスムーズになる一方、使い方を誤れば、情報漏洩や著作権の問題、誤情報の拡散など、思わぬリスクに直面することもあります。

だからこそ大切なのは、安心して使い続けるための「使い方のルール」を持つことです。企業はもちろん、個人でもガイドラインを意識した使い方が求められています。

もし、生成AIをこれから活用してみたい方、あるいは安全な運用方法に迷っている方がいれば、ぜひ生成AIセミナーにご参加ください。安全な活用法、業務効率化に役立つプロンプト入力方法を、実践的かつ効率的に習得できます。

セミナー名 生成AIセミナー 運営元 GETT Proskill(ゲット プロスキル) 価格(税込) 29,700円〜 開催期間 2日間 受講形式 対面(東京・名古屋・大阪)・ライブウェビナー・eラーニング

生成AIガイドラインについてまとめ

生成AIの登場により、ビジネスシーンの前提や常識は一気に覆り、その影響は計り知れないほど甚大です。しかし、生成AIは何でもできるわけではなく、性能面も万全ではありません。

だからこそ、利用者は生成AIにすべて依存するのではなく、あくまで自身の業務や意思決定をサポートする存在であることを認識したうえで使いましょう。そのための指針となるのが、生成AIガイドラインです。